Szokujące prognozy

Podsumowanie: Szokujące prognozy na 2026 rok

Saxo Group

Główny strateg inwestycyjny

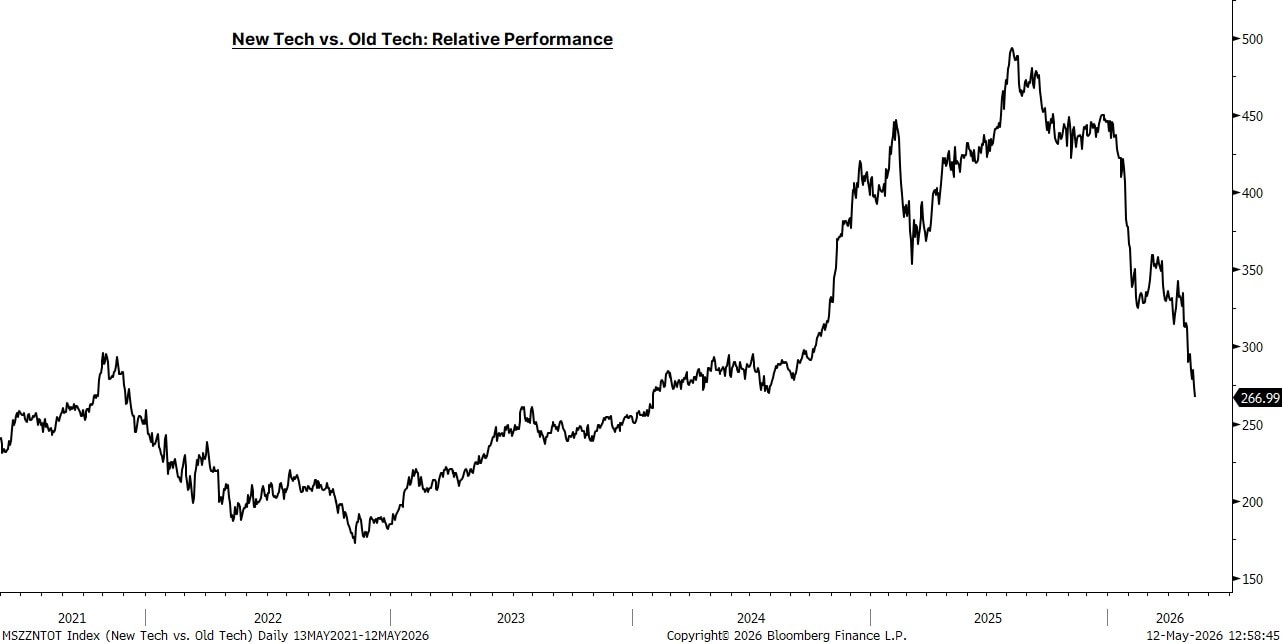

Sztuczna inteligencja zmienia krajobraz technologiczny — i to nie tylko w gronie najbardziej widocznych beneficjentów rynku GPU.

Kolejna faza polega mniej na uczeniu modeli, a bardziej na ich stałym wykorzystaniu w wyszukiwaniu, programowaniu, obsłudze klienta, procesach biznesowych oraz agentach AI.

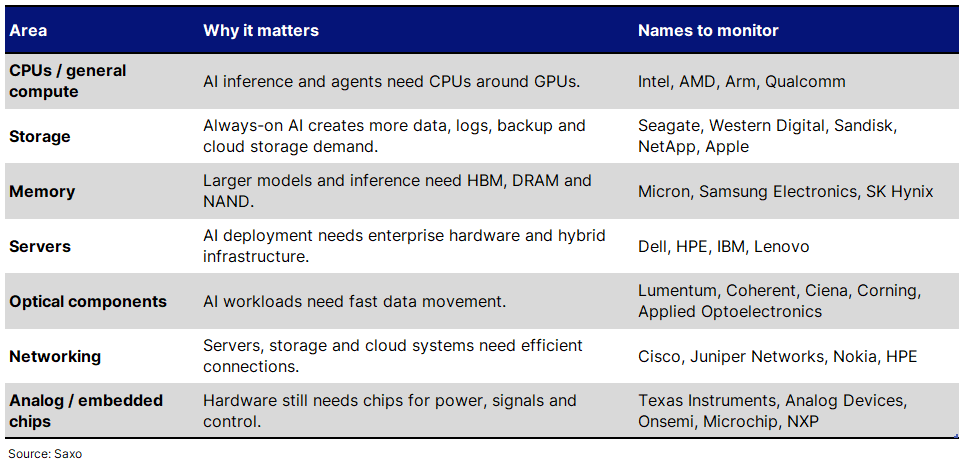

Ten zwrot przywraca na pierwszy plan bardziej tradycyjne obszary technologiczne: procesory CPU, pamięć operacyjną, pamięć masową, serwery, sieci, komponenty optyczne oraz układy analogowe.

Dla inwestorów kluczowe pytanie brzmi nie tylko „kto produkuje układy dla AI?”, ale też „kto buduje cały ekosystem — swoisty system operacyjny dla AI — wokół nich?”

Ryzyka pozostają znaczące: wiele z tych segmentów to rynki sprzętowe o cyklicznym charakterze, a kursy akcji części spółek mogą już odzwierciedlać wysokie oczekiwania związane z AI.

W pierwszej fazie inwestycji w sztuczną inteligencję dominowały układy graficzne (GPU). To było logiczne: uczenie dużych modeli wymaga ogromnej mocy obliczeniowej i przetwarzania równoległego, a GPU stały się głównym „wąskim gardłem”.

Obecnie jednak AI przechodzi z fazy uczenia do fazy wdrożeń i codziennego wykorzystania. Coraz głębiej wnika w codzienne zastosowania — od wyszukiwania, przez tworzenie oprogramowania i obsługę klienta, po narzędzia zwiększające produktywność, finanse, opiekę zdrowotną, systemy przemysłowe oraz agentów AI. W praktyce oznacza to konieczność zapewnienia stałej dostępności, obsługi większej liczby zapytań, przechowywania większych ilości danych, lepszego utrzymania kontekstu oraz szybkiego przesyłania informacji między systemami. Wymagania sprzętowe wykraczają więc poza same akceleratory i obejmują dodatkową moc obliczeniową, pamięć, przestrzeń dyskową, serwery oraz łączność.

To przesuwa akcent na to, co naprawdę liczy się w technologii. AI nie działa wyłącznie na GPU — potrzebuje kompletnego stosu sprzętowego oraz infrastruktury danych:

Układy GPU — aby przyspieszać przetwarzanie obciążeń AI.

Procesory — do koordynacji zadań i pracy całego systemu.

Pamięć — aby utrzymywać dane jak najbliżej miejsca przetwarzania.

Pamięć masowa — na dane, logi i dane historyczne.

Serwery — aby integrować i udostępniać ten sprzęt w centrach danych.

Sieci i łącza optyczne — aby przesyłać dane między systemami z dużą przepustowością i niskimi opóźnieniami.

Układy analogowe i wbudowane — do zarządzania zasilaniem, sygnałami i funkcjami sterowania.

Oto jak AI zmienia krajobraz technologiczny. Rynek patrzy nie tylko na najbardziej medialnych beneficjentów ery AI, lecz także na bardziej tradycyjne kategorie sprzętu, które umożliwiają działanie AI na dużą skalę.

GPU są kluczowe w przyspieszaniu obciążeń AI, ale to CPU nadal wykonują znaczną część pracy na poziomie całego systemu: odpowiadają za ładowanie danych, szeregowanie zadań, operacje wejścia/wyjścia (I/O), bazy danych, systemy wyszukiwania i przywoływania kontekstu, orkiestrację procesów oraz wieloetapowe przepływy pracy.

Rola CPU rośnie, gdy AI przesuwa się z fazy uczenia do ciągłego, „zawsze włączonego” wykorzystania. Chatbot, asystent kodowania czy agent AI muszą pobierać informacje, sprawdzać kontekst, wywoływać narzędzia, zarządzać pamięcią i wielokrotnie odpowiadać. To generuje większy popyt na zasoby obliczeniowe ogólnego przeznaczenia w otoczeniu GPU.

Spółki warte obserwacji: Intel, AMD, Arm.

AI tworzy i ponownie wykorzystuje ogromne ilości informacji. Zbiory danych treningowych, logi z wnioskowania, firmowe jeziora danych, bazy wektorowe, dane klientów, indeksy wyszukiwania, wyniki modeli i archiwa zgodności — wszystko to trzeba przechowywać i szybko odzyskiwać.

Ponownie w centrum uwagi znajdują się dyski twarde, pamięć flash i rozwiązania pamięci masowej dla przedsiębiorstw. Dyski twarde wciąż mają znaczenie w chmurach na dużą skalę, a pamięć flash jest kluczowa tam, gdzie liczą się szybkość i niskie opóźnienia.

Jest też aspekt konsumencki. Jeśli więcej funkcji AI działa lokalnie na komputerach PC, kompaktowych komputerach stacjonarnych i stacjach roboczych, intensywność wykorzystania pamięci i pamięci masowej może rosnąć również poza centrami danych. Problemy z dostępnością Mac mini i Mac Studio w ofercie Apple to czytelny sygnał, jak szersze ograniczenia pamięciowe potrafią przełożyć się na elektronikę konsumencką. Apple nie jest spółką stricte zajmującą się pamięcią masową, ale sam sygnał ma znaczenie.

Spółki warte obserwacji: Seagate, Western Digital, SanDisk, NetApp, Apple.

Pamięci stają się jednymi z najbardziej oczywistych beneficjentów popytu na sprzęt dla AI. Większe modele, dłuższe okna kontekstu i nieprzerwane przepływy pracy oparte na AI wymagają więcej pamięci o wysokiej przepustowości, DRAM i NAND.

Pamięć o wysokiej przepustowości (HBM) już stała się kluczowym wąskim gardłem dla akceleratorów AI. Jednocześnie szerszy popyt na pamięć ma znaczenie w miarę skalowania wnioskowania i wzbogacania coraz większej liczby aplikacji o funkcje AI.

Spółki warte obserwacji: Micron, Samsung Electronics, SK Hynix.

AI nie eliminuje tradycyjnych serwerów — często zwiększa zapotrzebowanie na nie.

Wyspecjalizowane serwery przystosowane do obciążeń GPU są potrzebne, ale firmy wciąż wymagają serwerów do baz danych, zarządzania pamięcią masową, obsługi wnioskowania, infrastruktury hybrydowej i ogólnych zadań związanych z wdrażaniem AI.

Stąd powrót tradycyjnych dostawców sprzętu dla przedsiębiorstw na listy obserwacyjne inwestorów. Otwartym pytaniem pozostaje, czy AI zainicjuje trwały cykl odnowy serwerów, a nie tylko jednorazowy skok popytu.

Spółki warte obserwacji: Dell Technologies, Hewlett Packard Enterprise, IBM, Lenovo.

Wraz z rosnącymi obciążeniami AI dane muszą szybko przemieszczać się między serwerami, systemami pamięci masowej i klastrami obliczeniowymi. To napędza popyt na komponenty optyczne, światłowody, przełączniki, routery i szybkie sieci.

Łącza optyczne są szczególnie ważne, ponieważ obciążenia AI wymagają bardzo szybkiej transmisji o niskich opóźnieniach. Znaczenie mają też dostawcy rozwiązań sieciowych, ponieważ wdrożenia AI wymagają sprawnych połączeń w ramach systemów korporacyjnych, centrów danych i chmury.

Spółki warte obserwacji: Lumentum, Coherent, Ciena, Corning, Applied Optoelectronics, Cisco, Juniper Networks, Nokia, Hewlett Packard Enterprise.

Sprzęt dla AI wciąż wymaga układów scalonych, które zarządzają zasilaniem, sygnałami i funkcjami sterowania. Tu na znaczeniu zyskują firmy zajmujące się układami analogowymi i wbudowanymi.

To nie są najbardziej medialne marki AI, ale te układy znajdują się w serwerach, systemach przemysłowych, sprzęcie centrów danych, motoryzacji oraz urządzeniach połączonych z siecią. W miarę jak AI przenika do coraz większej liczby systemów fizycznych, rośnie zapotrzebowanie na zarządzanie energią, czujniki, konwersję sygnałów i wbudowane sterowanie.

Spółki warte obserwacji: Texas Instruments, Analog Devices, onsemi, Microchip Technology, NXP.

To nie jest rekomendacja inwestycyjna. To narzędzie do monitorowania tego, gdzie popyt związany z AI może rozszerzać się na bardziej tradycyjne kategorie technologii.

Największe ryzyko polega na tym, że inwestorzy dostrzegają rzeczywisty trend i nadmiernie go ekstrapolują.

AI może wspierać popyt na CPU, pamięć masową, pamięć operacyjną, serwery, komponenty optyczne oraz sieci, ale wiele z tych segmentów wciąż działa na rynkach sprzętowych o cyklicznym charakterze. Popyt bywa nierówny, podaż może dogonić popyt, trend cenowy może się odwrócić, a klienci mogą wstrzymać wydatki, jeśli monetyzacja AI okaże się rozczarowująca.

Kluczowe ryzyka obejmują:

Wolniejsze tempo nakładów inwestycyjnych na AI: hiperskalery, czyli najwięksi dostawcy usług chmurowych, mogą ograniczyć lub opóźnić wydatki po intensywnym cyklu inwestycyjnym.

Opóźnione upowszechnienie w przedsiębiorstwach: firmy mogą wdrażać AI na szeroką skalę wolniej niż zakłada rynek.

Reakcja podaży: podaż pamięci, pamięci masowej lub serwerów może dogonić popyt, osłabiając pozycję cenową dostawców.

Presja na marże: wzrost przychodów nie musi przełożyć się na wyższe zyski, jeśli nasili się konkurencja lub wzrosną koszty komponentów i materiałów.

Substytucja technologiczna: układy niestandardowe lub wyspecjalizowane architektury mogą ograniczyć popyt na część tradycyjnych komponentów.

Ryzyko wyceny: wiele akcji powiązanych ze sprzętem AI ma już wysokie wyceny po silnych wzrostach.

AI zmienia krajobraz technologiczny, wychodząc poza GPU. W miarę jak AI przechodzi z uczenia do codziennych wdrożeń, baza popytu może rozszerzać się na CPU, pamięć masową, pamięć operacyjną, serwery, komponenty optyczne, sieci oraz układy analogowe.

Dla inwestorów to bardziej praktyczny sposób myślenia o kolejnej fazie AI: nie tylko o tym, które firmy tworzą modele AI, lecz także o tym, które dostarczają i wspierają stos sprzętowy oraz infrastrukturę danych, dzięki którym AI działa nieprzerwanie.

Niniejsza treść jest materiałem marketingowym i nie powinna być traktowana jako porada inwestycyjna. Handel instrumentami finansowymi wiąże się z ryzykiem, a historyczne wyniki nie stanowią gwarancji przyszłych wyników.

Instrumenty, o których mowa w niniejszej treści, mogą być emitowane przez partnera, od którego Saxo otrzymuje opłaty promocyjne, płatności lub retrocesje. Chociaż Saxo może otrzymywać wynagrodzenie z tytułu tych partnerstw, wszystkie treści są tworzone w celu dostarczania klientom cennych informacji i opcje....